Vielleicht hat Metas Datenbrille ein Datenschutzproblem In einigen Fällen können aufgezeichnete Videos versehentlich von den Personen angesehen werden, die die KI-Systeme trainieren — Hoppla!

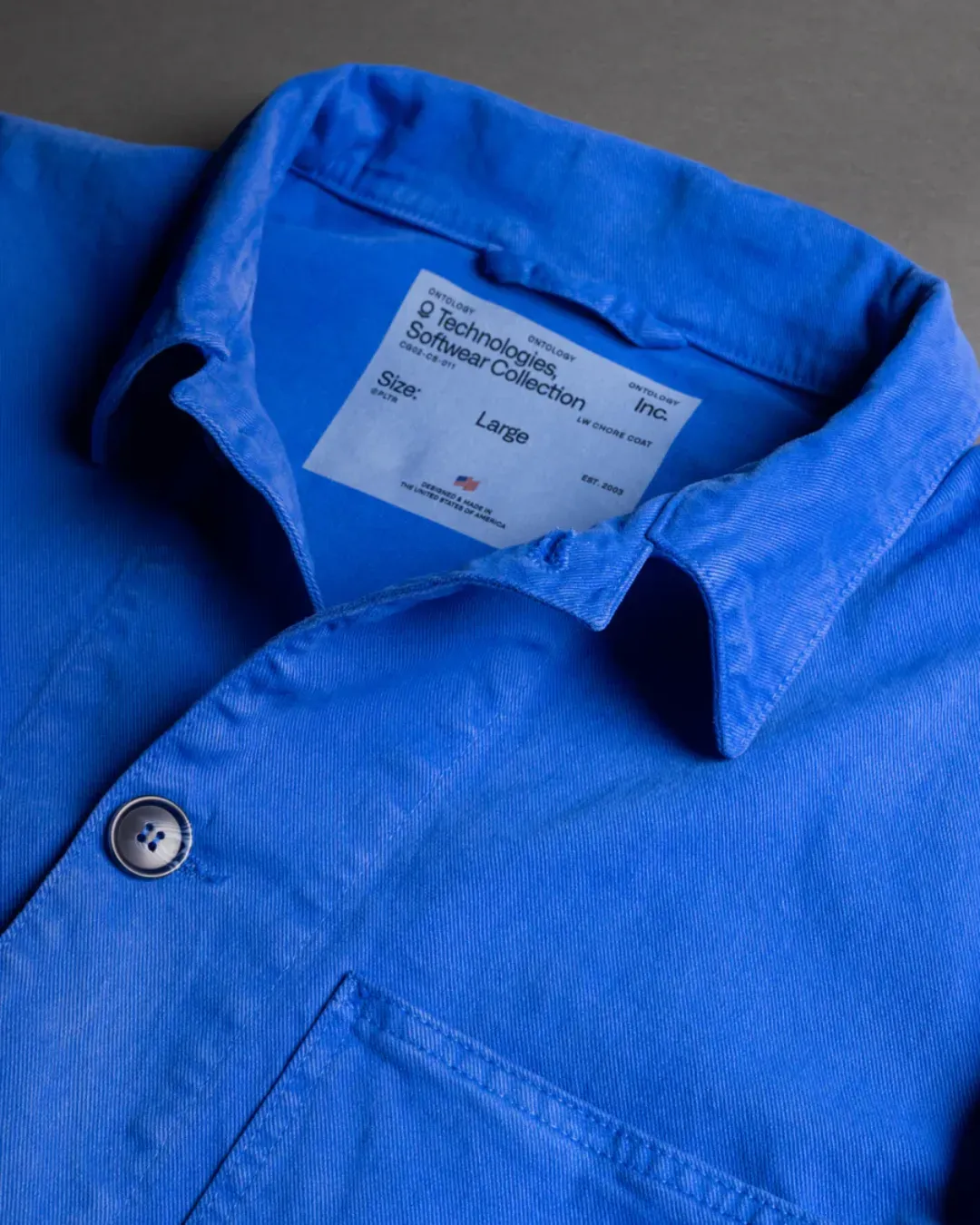

Die neuesten Modelle der Meta Smart Glasses, die in Zusammenarbeit mit Ray-Ban und Oakley entwickelt wurden, verfügen über ein künstliches Intelligenzsystem, das die Funktionen des Geräts, einschließlich Videoaufzeichnung und Telefonanrufe, unterstützt und verbessert. Mit der Brille können Benutzer auch mit dem KI-Assistenten interagieren, um Nachrichten zu senden oder eine Audiobeschreibung dessen zu erhalten, was die Kamera aufnimmt.

Von Benutzern erfasste Inhalte bleiben in der Regel auf dem Gerät gespeichert, mit dem sie aufgenommen wurden, es sei denn, der Benutzer teilt sie mit Meta, um zur Serviceverbesserung beizutragen. In einigen Fällen können gemeinsam genutzte Daten und Inhalte jedoch einer manuellen Überprüfung durch menschliche Mitarbeiter unterzogen werden, um die integrierten Systeme der künstlichen Intelligenz im Produkt zu verfeinern und zu trainieren. Nach Angaben des Unternehmens werden die überprüften Materialien gefiltert oder teilweise verdeckt, um die Privatsphäre der Beteiligten zu schützen.

Eine Untersuchung der schwedischen Zeitungen Svenska Dagbladet und Göteborgs‑Posten ergab, dass diese Filter nicht immer wirksam sind: Berichten zufolge konnten Rezensenten in einigen Fällen die Gesichter der aufgezeichneten Personen deutlich erkennen — ein großes Datenschutzproblem für die Nutzer.

Der Fall mit Metas Datenbrille

@cathypedrayes PSA: Meta glasses A Swedish investigation found that Meta’s human AI workers (who work in Kenya to help train the AI) have seen sensitive videos of people changing, in bedrooms, financial information, etc. and it’s probably because people don’t realize this can happen. Meta does try to blur faces and details but the system isn’t perfect so just assume if your glasses can record it, a person might see it. Don’t record anything private, credit cards, information, changing clothes, etc. #smartglasses #technews #onlinesafety #AI #thingsyoushouldknow original sound - dj auxlord

Meta verlässt sich unter bestimmten Umständen seit langem auf Mitarbeiter von Vertragsunternehmen, um die Leistung seiner technologischen Produkte zu verbessern, einschließlich der mit seinen Datenbrillen aufgenommenen Videos. Beschäftigte, die von schwedischen Journalisten interviewt wurden, die für ein in Nairobi ansässiges Unternehmen namens Sama in Kenia angestellt sind, berichteten, dass sie damit beauftragt wurden, KI beizubringen, in Videos enthaltene Informationen zu interpretieren, indem sie Objekte, die in ihnen erscheinen, manuell beschrifteten.

Ihren Aussagen zufolge griffen sie während dieser Operationen auf Inhalte aller Art zu, einschließlich intimer Szenen. Sie gaben auch an, Zugriff auf Transkriptionen einiger Konversationen zwischen Benutzern und der KI zu haben, um zu überprüfen, ob das System auf Fragen korrekt reagiert hat. Meta antwortete auf die Untersuchung und erklärte, dass die Möglichkeit, dass mit seiner Brille aufgenommene Videos von externen menschlichen Rezensenten angesehen werden, in seiner Datenschutzrichtlinie angegeben ist.

Die Arbeit derer, die KI-Systeme trainieren

@evhandd A new report just dropped claiming that the footage from user’s Meta Glasses is being sent to an annotation center in Kenya... Where employees WATCH THE VIDEOS TO HELP TRAIN META’S AI! And these employees say they have seen EVERYTHING

original sound - Evan

In den letzten Jahren haben sich mehrere journalistische Untersuchungen mit einem Thema befasst, über das Technologieunternehmen in der Regel wenig sprechen und das, wenn es auftaucht, regelmäßig die öffentliche Debatte neu entfacht: die sogenannte Datenkennzeichnung, bei der verschiedene Arten von Daten — wie Audio, Video, Bilder oder Text — gekennzeichnet werden, um künstliche Intelligenzsysteme zu trainieren. Diese Aufgaben sind oft schlecht bezahlt und wiederholen sich, sodass Mitarbeiter manchmal gewalttätigen oder verstörenden Inhalten ausgesetzt sind. Sie sind jedoch unerlässlich, um KI effizienter zu machen — auch wenn Technologieunternehmen sie oft herunterspielen.

In den letzten Jahren wurde diese Aktivität auch durch das sogenannte „Reinforcement Learning with Human Feedback“ (RLHF) begleitet, bei dem menschliche Bewertungen verwendet wurden, um die Ergebnisse der KI zu beurteilen. Ziel war es, Systeme zu genaueren oder nützlicheren Reaktionen zu führen und die Leistung schrittweise zu verbessern. Diese Aufgaben werden in großem Umfang von großen Technologieunternehmen wie Google, Microsoft und OpenAI angefordert und häufig an Drittunternehmen in Entwicklungsländern wie Kenia oder Nepal ausgelagert, wo die Arbeitskosten viel niedriger sind. Darüber hinaus ist die Rekonstruktion dieser Aktivitäten komplex, da Bauunternehmen häufig äußerste Vertraulichkeit verlangen, um zu verhindern, dass Details über die Funktionsweise oder Entwicklung der Technologien, an denen sie arbeiten, durchsickern.