Musica e AI, a che punto siamo? Un riassuntone sulla nuova tecnologia, dai deepfake alle proteste degli artisti

Ogni volta che viene introdotta una nuova tecnologia nel campo dell’arte si creano schieramenti opposti, riconducibili alle due categorie proposte da Umberto Eco nel suo famoso saggio Apocalittici e integrati (1964). Da una parte i totalmente contrari, dall’altra i favorevoli. Un esempio su tutti potrebbe essere quello della fotografia: quando venne introdotta alcuni “apocalittici” – tra cui C. Baudelaire e Walter Benjamin - ipotizzarono che una tale tecnologia, talmente potente da riprodurre un’immagine perfettamente identica della realtà, avrebbe significato la fine della pittura e dell’illustrazione. Ma come sappiamo non è andata esattamente così e la fotografia è diventata una nuova arte. La resistenza alla tecnologia è sempre stata particolarmente dura e ostile nel campo della musica, basti pensare a quanta fatica ha dovuto fare la musica elettronica prima che le venisse riconosciuta una dignità pari a quella della “musica suonata con gli strumenti”. In tempi più recenti, il settore ha dovuto affrontare anche numerosi cambiamenti tecnologici nelle sue modalità di fruizione e di distribuzione, cosa che ha generato non pochi contrasti di natura etica ed economica. Si pensi al passaggio dai cd agli Mp3 e all’avvento di Napster e degli altri sistemi di condivisione peer-to-peer, che hanno fatto proliferare la pirateria. Oppure alla più recente smaterializzazione totale della musica e ai nuovi accordi tra case discografiche e piattaforme di streaming. La fruizione della musica da parte del pubblico è una cosa che viene spesso ignorata nei discorsi sull’AI, ma è importante tanto quanto le modalità di creazione della musica stessa.

I primi passi dell’AI nella creazione musicale

I primi esperimenti sul potenziale musicale dell’AI generativa vennero accolti in gran parte come innocui divertissement. Si pensi a Daddy's Car, un brano in stile Beatles risalente ormai a quasi dieci anni fa (era il 2016) in cui per la prima volta la musica era stata composta dal programma di IA Flow Machines. Molti probabilmente non l’avranno mai sentita, perché all’epoca queste “canzoni” erano ancora considerate dei semplici esperimenti al limite con lo scherzo. Quattro anni dopo, in piena pandemia, arrivarono i cosiddetti jukebox samples generati da OpenAI, che erano sostanzialmente degli esercizi di stile della durata di un minuto in cui si mescolavano generi musicali e stili di artisti diversi, con titoli del tipo Folk Rock alla Simon and Garfunkel. Proprio a causa dell’uso dei nomi degli artisti reali, questi sample oggi non sono più disponibili su Soundcloud.

I Deepfake

@emortalye Kanye ft Carti #praiselordkanye #eatemos #musicai #aimusic Originalton - emortalye

Negli ultimi cinque anni le cose si sono fatte decisamente più serie. Tra i casi percepiti per lo più come negativi c’è il fenomeno dei cosiddetti deepfake, che continuano ancora oggi a proliferare su YouTube e TikTok. Si tratta in sostanza di canzoni che sfruttano l’intelligenza artificiale per ricreare le voci di cantanti famosi. Il caso più eclatante è stato quello di Heart On My Sleeve, il finto brano di Drake e The Weeknd pubblicato nel 2023 dal producer anonimo Ghostwriter. La somiglianza delle voci e la notorietà dei due personaggi ha fatto sì che un falso arrivasse a totalizzare più di 20 milioni di ascolti prima che la Universal riuscisse a farlo rimuovere da tutte le piattaforme di streaming. Tra gli altri esperimenti più noti ci sono stati anche Jay Z che recita Shakespeare, Kanye West che canta Somebody That I Used To Know e persino un intero album inedito degli Oasis - Aisis, The Lost Tapes Vol. 1 - che in realtà non era altro che un disco della band Breezer in cui la voce del cantante era stata sostituita da quella di Liam Gallagher riprodotta con l'AI.

Se quelli precedenti possono essere considerati alla stessa stregua di un bene contraffatto, come un Rolex falso o una semplice imitazione, ci sono altri casi che potremmo considerare più o meno virtuosi, o dove perlomeno la questione legale non sussiste e quella etica è più dibattuta. Un primo esempio è quello di Grime: partita soft con il progetto AI Lullaby - che permetteva di combinare la sua voce con suoni ambient per aiutare i bambini a prendere sonno - in seguito la cantante ha deciso di mettere a disposizione la sua voce affinché chiunque potesse usarla per creare nuovi brani con l'AI, sviluppando così un continuum potenzialmente infinito. Per quanto estrema, nessuno può contestare questa scelta dal punto di vista etico e legale, trattandosi in questo caso di una libera espressione della sua personale visione artistica ed essendo lei stessa l’unica persona titolare dei diritti sulla sua voce e sulla sua musica.

Il caso virtuoso ad oggi più eclatante è sicuramente quello che nel 2024 ha portato alla pubblicazione di una nuova canzone dei Beatles – Now And Then - vincitrice anche di un Grammy nella categoria Best Perfomance Rock. Rispetto a Daddy’s Car siamo letteralmente su un altro pianeta (per chi volesse approfondire esiste un mini-documentario che riepiloga tutta la storia del brano): in origine si trattava di un vecchio nastro con un’incisione casalinga di John Lennon, la cui qualità purtroppo era di fatto troppo scadente per tirarne fuori qualcosa di buono. Gli altri componenti dei Beatles ci avevano già provato in passato, ma il tentativo di rielaborarla in una canzone fatta e finita era stato abbandonato proprio a causa della scarsa qualità dell’audio. Tuttavia, in seguito allo sviluppo di una nuova tecnologia legata all’intelligenza artificiale - la stessa utilizzata da Peter Jackson per il documentario Get Back - è stato possibile isolare l’audio e raggiungere una qualità accettabile per la pubblicazione del brano. Questa operazione potrebbe essere considerata in un certo senso come qualcosa che si avvicina all’idea di restauro dei beni culturali. E se il risultato finale è quello di avere a disposizione una nuova bella canzone del più grande gruppo musicale della storia, il giudizio complessivo non può che essere positivo.

Pro e contro della musica AI

Una possibile degenerazione futura delle pratiche esposte finora potrebbe essere quella di farsi prendere un po’ troppo la mano e scadere nel cattivo gusto di pubblicare milioni di nuove canzoni di cantanti morti generate dall’AI. Detta così può sembrare una distopia, ma considerato l’interesse del pubblico per gli album postumi e la tendenza delle case discografiche a raschiare il fondo del barile pur di pubblicare nuova musica di artisti deceduti, non si dovrebbe sottovalutare troppo la questione. Pensate solo a quanti dischi di Jeff Buckley sono stati pubblicati dopo la sua morte o ai bozzetti di infima qualità contenuti nel fantomatico disco solista di Kurt Cobain. Certo, in questi casi almeno si poteva parlare di brani dal valore storico, perché esistevano delle tracce registrate intenzionalmente dall’artista, ma se venisse meno anche la base di partenza, quale valore avrebbero le canzoni? Difficile da dire. E come giudicheremmo la cosa, invece, se l’intelligenza artificiale venisse utilizzata per “aiutare” quei cantanti che sono ancora in vita ma che per ragioni di salute hanno dovuto smettere di cantare? Sarebbe una cosa positiva o negativa se uno come Steven Tyler, che è stato costretto ad abbandonare le scene, oggi decidesse di addestrare l’AI per riprodurre la sua voce e fare un disco nuovo degli Aerosmith? Anche in questo caso è difficile da dire, ma arrivati a questo punto probabilmente non siamo più così lontani dal scoprilo.

La questione del pubblico e la musica funzionale

Sembra che una buona fetta del pubblico generalista oggi non sia più tanto interessato a conoscere chi è l’artista che ascolta, ma abbia molto più a cuore il mood generale che viene trasmesso. Per questo proliferano le playlist generate direttamente dagli editor della piattaforma o dall’algoritmo, in particolare quelle che propongono la cosiddetta “musica funzionale”, cioè la musica da ascoltare per fare determinate attività come andare a correre, studiare, dormire oppure quelle che veicolano un certo mood come il relax o la malinconia. Da qui sono nati gli accordi tra due grosse case discografiche - Warner e Universal – e la società Endel, che è praticamente leader nel settore della creazione di musica funzionale destinata a ridurre lo stress tramite l’AI. Sul profilo Spotify della società ci sono interi album con titoli che si commentano da soli, come The Most Beautiful Calm o Antarctican Dream Machine (Relax Soundscape).

La questione degli artisti fantasma

Se la musica prodotta dall’AI di Endel viene dichiaratamente fatta alla luce del sole, la stessa cosa non si può dire per quella prodotta dai cosiddetti artisti fantasma di Spotify. La vicenda è stata portata a nuova luce dalla giornalista Liz Pelly in un libro di recente pubblicazione intitolato Mood Machine - The Rise of Spotify and the Costs of the Perfect Playlist. In pratica, dall’inchiesta è emerso che Spotify si avvale di società esterne - che fanno comunque capo alla piattaforma - commissionando loro la creazione di brani strumentali che poi vengono inseriti nelle playlist più ascoltate con nomi di artisti fittizi in modo da genere royalties successivamente redistribuite alla piattaforma stessa. Al momento ci sono poche certezze su come vengano creati e su chi siano gli autori di questi brani, ma la possibilità che ci sia dietro una dose di AI non è da escludere. Del resto la principale società che si cela dietro ai fake artists – la Epidemic Sound – ha già dichiarato apertamente di consentire ai suoi compositori l’uso dell’AI.

Il quadro normativo – Perché gli artisti protestano?

first new release from kate bush since like 2011 and it’s literally silence pic.twitter.com/9FkVMEHmLO

— kate bush’s aquarius moon (@cloudbusting) February 25, 2025

Alla luce di quanto esposto finora, gli artisti fanno bene a protestare contro le ingerenze dell’AI? Dipende da quali sono le preoccupazioni, ma è vero che a livello normativo c’è ancora molto lavoro da fare. Nei giorni scorsi ha fatto molto discutere la proposta di legge del governo inglese volta a concedere la possibilità di allenare l'AI con i prodotti culturali protetti da copyright. La levata di scudi che ne è seguita ha dato vita a un collettivo di mille musicisti – tra i quali anche Kate Bush e Damon Albarn dei Blur – che hanno pubblicato un silent album di protesta - ovvero un disco composto simbolicamente da dodici tracce vuote, i cui titoli messi uno in fila all’altro compongono la frase: The British Government Must Not Legalise Music Theft To Benefit AI Companies (Il governo britannico non deve legalizzare il furto di musica per beneficiare le società di AI). Negli USA il primo stato a emanare una legge che tuteli i musicisti dagli abusi dell’AI è stato il Tennessee, dove l’anno scorso è entrato in vigore il cosiddetto Elvis Act (Ensuring Likeness Voice and Image Security). Il problema è che, trattandosi di una legge statale e non federale, non ha alcun valore al di fuori dei confini del singolo stato. A livello federale, invece, al momento la cosa più vicina a una tutela contro gli abusi dell’AI è una legge sulla pubblicità che impedisce l’utilizzo della propria voce nelle pubblicità senza che sia stato dato il consenso. Per quanto riguarda l’Unione Europea, invece, proprio a partire da quest’anno è iniziata la prima fase di introduzione a tappe dell’AI Act, ma la strada è ancora lunga e il suo impatto così come la sua efficacia sono ancora tutte da verificare.

Il parere degli esperti sulla musica AI

@innerkaizen Miyazaki Hayao on AI: #miyazaki #hayaomiyazaki #ghibli Ladyfingers by Herb Alpert and The Tijuana Brass - Mieze Katz

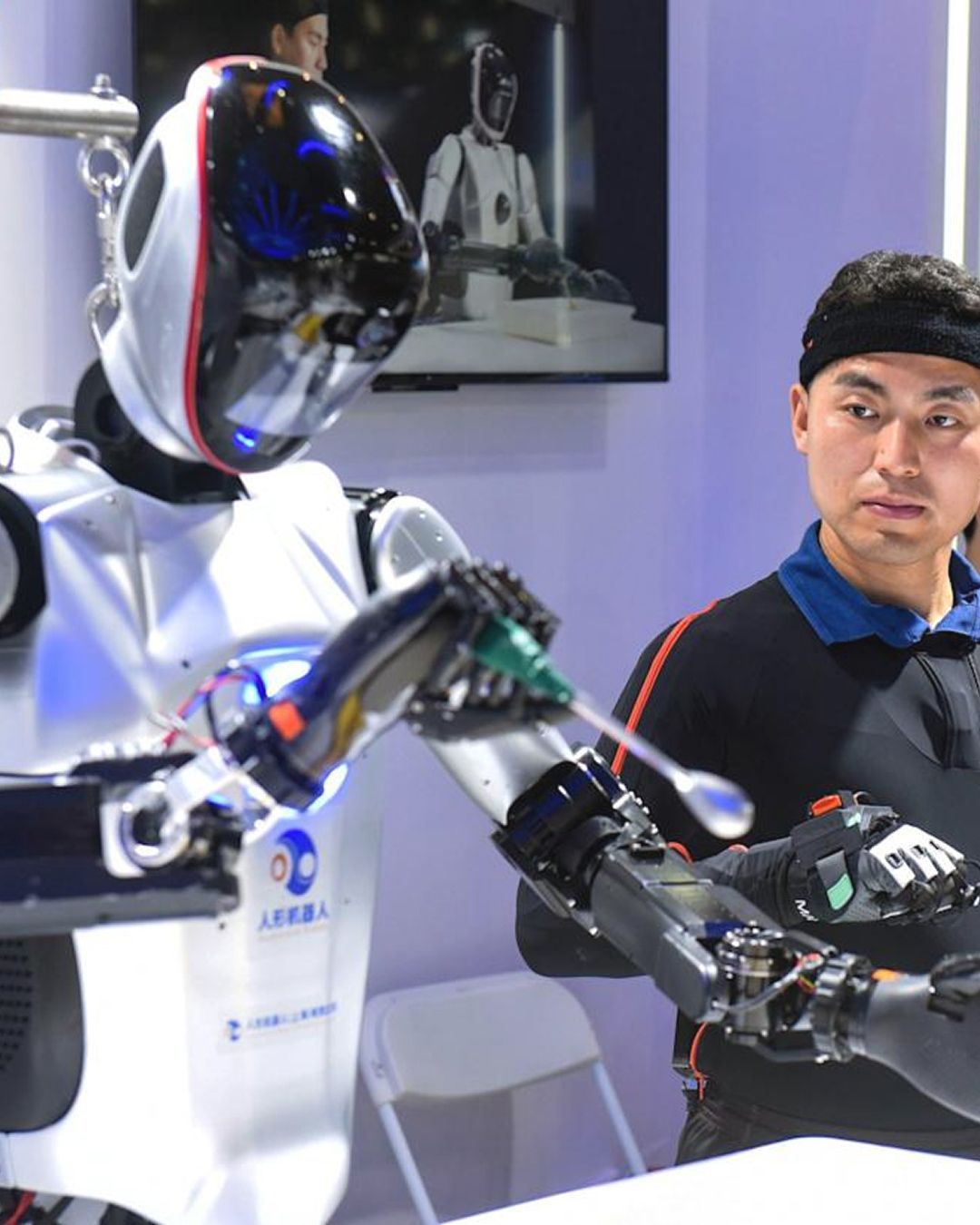

Secondo Francesca Lagioia – docente di Informatica giuridica, IA e Diritto ed etica per l'IA presso l’Università di Bologna - l’arte creata dall’intelligenza artificiale non potrà mai sostituire o essere paragonata a quella creata dall’essere umano perché la capacità creativa dell’AI è solo di tipo «combinatorio», cioè è soltanto capace di riassemblare idee pre-esistenti, ma non è in grado di generare un’idea nuova. Confortante, anche se questo in realtà apre un mondo di speculazioni filosofiche su quali siano effettivamente gli estremi per considerare un’idea nuova. Quando gli è stata mostrata un’animazione creata con l’AI, il maestro dell’animazione giapponese Hayao Miyazaki si è detto disgustato, non per principio, ma perché quanto prodotto gli sembrava la parodia di una persona affetta da disabilità motorie e a suo parere solo una macchina che non ha nessuna cognizione del dolore umano poteva concepire una simile aberrazione. Per quanto pura, questa visione del regista giapponese sembra un po’ troppo innocente ai nostri cinici occhi occidentali per risultare del tutto convincente. Più concreta e rassicurante la posizione del critico musicale Simon Reynolds, il quale ha sottolineato con il suo solito acume una cosa apparentemente ovvia: l’AI «non ascolta» la musica - non ha orecchie né corpo - ma tutta la musica agisce su di noi attraverso le nostre facoltà sensoriali e cinestetiche. L’AI non può capire fino in fondo la musica perché non ha la nostra stessa esperienza fisica e neuronale.

Infine, la risposta che appare più complessa e convincente, proprio perché più viscerale e umana, è quella data da Nick Cave qualche anno fa in risposta a un fan che aveva provato a scrivere una canzone “alla Nick Cave” con l’ausilio dell'AI:

«Scrivere una buona canzone non è imitazione, o replica, o pastiche, è il contrario. È un atto di auto-omicidio che distrugge tutto ciò che si è cercato di produrre in passato. Sono quelle partenze pericolose, che fermano il cuore e catapultano l’artista oltre i limiti di ciò che lui o lei riconosce come il suo sé conosciuto. Questo fa parte dell’autentica lotta creativa che precede l’invenzione di un testo unico di reale valore; è il confronto senza fiato con la propria vulnerabilità, la propria pericolosità, la propria piccolezza, contrapposto a un senso di scoperta improvvisa e scioccante; è l’atto artistico redentore che muove il cuore dell’ascoltatore, dove l’ascoltatore riconosce nel funzionamento interno della canzone il proprio sangue, la propria lotta, la propria sofferenza. Questo è ciò che noi umili esseri umani possiamo offrire, che l’IA può solo imitare, il viaggio trascendente dell’artista sempre alle prese con i propri difetti. È qui che risiede il genio umano, profondamente radicato dentro, ma che va oltre, quelle limitazioni»