Che cos’è il “nazionalismo AI”? Sempre di più, ci muoviamo verso la distopia

Mentre il pubblico generale usa le AI per creare video surreali di gatti, psicanalizzarsi o anche fare shopping, le maggiori potenze mondiali stanno scoprendo che questa tecnologia ha applicazioni molto più vaste, per non dire sinistre, sia in campo amministrativo che bellico. C’è solo un problema: tutte le principali AI sviluppate oggi sono americane e cinesi e dunque utilizzarle per scopi governativi suscita diversi e inquietanti dubbi sulla sicurezza nazionale e sul vero utilizzo dei dati che impiega.

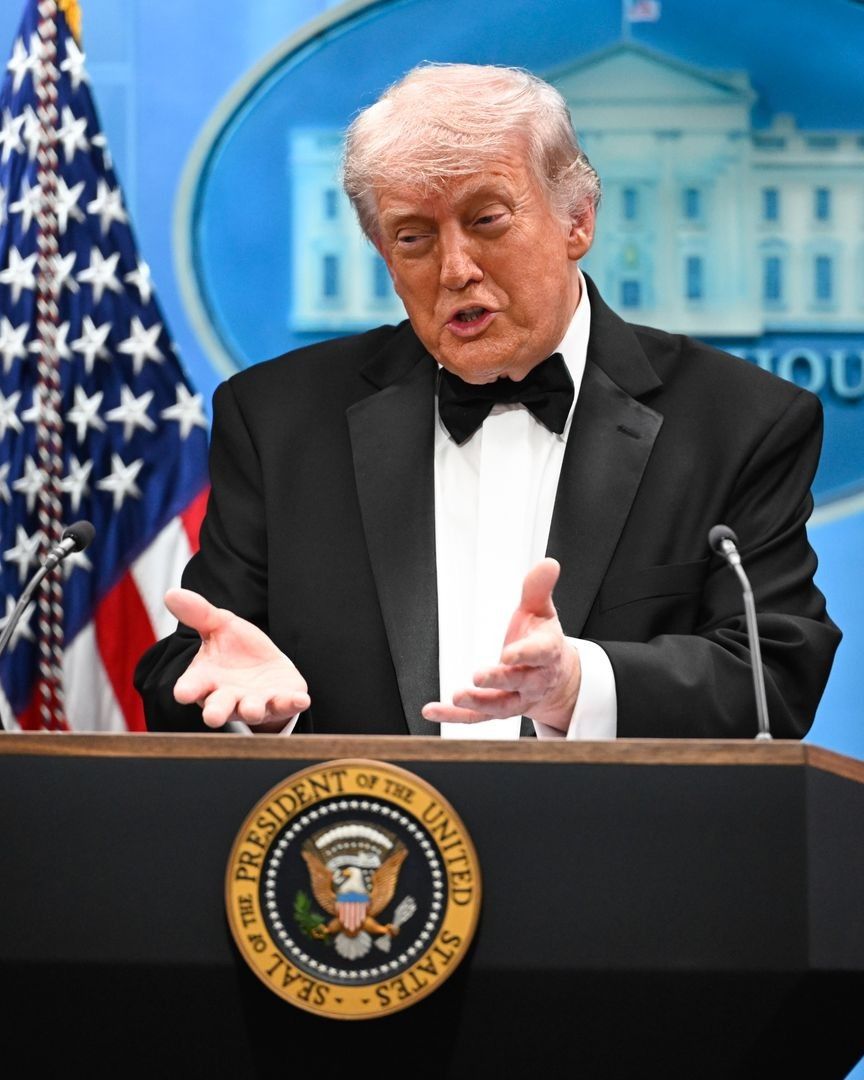

Questo mese, il dibattito sul nazionalismo delle AI è scoppiato negli Stati Uniti dove il Pentagono ha designato Anthropic come un rischio per la sicurezza nazionale dopo che l’azienda ha rifiutato di rimuovere le restrizioni sull’uso dei suoi modelli Claude per sorveglianza di massa dei cittadini e dei sistemi d’arma autonomi. È forse la prima volta che il governo americano getta discredito su un’azienda per questi motivi.

Dopo il blacklisting di Anthropic, OpenAI ha siglato un contratto da 200 milioni di dollari con il Dipartimento della Difesa, dichiarando che le decisioni operative su questi sistemi spettano al governo e non alle imprese private e di fatto subentrando all’azienda grazie all’assenza degli stessi limiti etici. Nel frattempo, Trump aveva firmato già a dicembre un ordine esecutivo per cancellare le regolamentazioni statali sull’AI, i cui investimenti stanno diventando un motore economico che l’amministrazione non intende lasciare in mani private. Ma cosa succede quando il potere delle AI diventa uno strumento di controllo governativo?

Che cos’è il nazionalismo AI?

@carterpcs This AI is officially an enemy of the US government #ai #claude #anthropic #carterpcs #trump I Can Do Anything / Finale - Christopher Lennertz

Il nazionalismo AI è una dottrina che sostiene che ogni nazione dovrebbe sviluppare e controllare in modo esclusivo le proprie tecnologie di intelligenza artificiale per garantire sovranità tecnologica e tutelare interessi economici, militari e geopolitici. L’idea ha guadagnato visibilità internazionale grazie al saggio AI Nationalism pubblicato nel 2018 dall’investitore britannico Ian Hogarth, che ha definito questa tecnologia come una risorsa strategica pari al nucleare o al petrolio. In gioco c’è l’influenza globale dei singoli stati.

Un esempio fatto da Hogarth è quello della vendita, da parte del Regno Unito, di DeepMind a Google nel 2014 per circa 400 milioni di sterline. DeepMind era un laboratorio britannico di punta nello sviluppo delle AI e secondo lo scrittore sarebbe stato meglio se il governo britannico avesse bloccato l'acquisizione o aiutato a tenerlo indipendente, per non cedere questo importante asset a un gigante americano. Se l’avesse tenuto oggi il Regno Unito avrebbe una leva di forza politica non da poco nello scacchiere geopolitico mondiale.

Quali sono gli esempi recenti di nazionalismo AI?

Should we nationalize AI? That is, should we replace xAI, Anthropic, OpenAI, and others with a government organization?

— Daniel Lemire (@lemire) March 15, 2026

Hell no! And let me tell you why it’s a terrible idea.

One of Canada’s leading newspapers is publishing a piece by Bruce Schneier where he calls for the… pic.twitter.com/EJdUTdQcrE

Negli USA il nazionalismo AI è una dottrina che è stata ampiamente abbracciata: il governo ha ad esempio bloccato gli export di chip avanzati alla Cina per rallentare il governo cinese che ha annunciato piani per ottenere leadership AI entro il 2030 mentre paesi come Francia, India, Emirati Arabi stanno investendo miliardi nella creazione di AI nazionali e infrastrutture tecnologiche proprie.

E dopo l’ordine esecutivo di dicembre 2025 che intende nazionalizzare la legislatura in tutti gli stati USA, è nata una “AI Litigation Task Force” per affrontare le inevitabili cause in tribunale che ne deriveranno, mentre una legge che dà al governo il potere di controllare produzione e investimenti di aziende-chiave in casi di emergenza nazionale è stato invocata come possibile strumento per dichiarare l’AI una risorsa strategica prioritaria. Nel dibattito poi non mancano preoccupazioni sui data center, enormi stabilimenti che divorano ancora più enormi quantità di acqua e che stanno apparendo un po’ ovunque negli Stati Uniti terrorizzando diverse comunità.

I pro e i contro della nazionalizzazione delle AI

È chiaro che, al netto di preoccupazioni sulla privacy dei cittadini, la nazionalizzazione delle AI ha chiari vantaggi nei campi di sicurezza nazionale e controllo strategico. In un mondo perfetto (e dunque non il nostro) lo Stato potrebbe appropriarsi dello sviluppo di queste tecnologie eliminando il rischio che una serie di mega-aziende ne facciano un oligopolio mondiale con implicazioni ancora peggiori per la stabilità globale o la sicurezza collettiva.

Sempre in un mondo ideale, il controllo pubblico garantirebbe più trasparenza verso i cittadini su come vengono usati i dati e su quali sono le applicazioni effettive della tecnologia, riducendo il pericolo di abusi nascosti dietro accordi commerciali riservati. Inoltre, la nazionalizzazione permetterebbe di concentrare risorse nazionali come finanziamenti, talenti, infrastrutture verso un unico obiettivo, accelerando gli avanzamenti nello sviluppo della tecnologia. In pratica, una policy simile a quella che esiste sull’arricchimento dell’uranio e la creazione di armi nucleari.

Eppure gli svantaggi sono ancora più ovvi. L’idea di un’entità governativa nelle cui mani si concentra tanto potere, specialmente di sorveglianza, che i rischi di abuso politico, censura o utilizzo per scopi autoritari sono semplicemente troppo palesi. Inoltre la tecnologia AI si sviluppa in una maniera troppo rapida e spesso collaborativa per stare dietro alle lentissime burocrazie amministrative e dunque, in base allo stato, l’innovazione potrebbe muoversi in modo parecchio lento. Inoltre acquisire o nazionalizzare aziende valutate centinaia di miliardi di dollari richiederebbe risorse pubbliche colossali, con il rischio di shock finanziari, aumento del debito o distorsioni nel mercato del lavoro e degli investimenti.

Il tema però è che per una tecnologia che si basa su una diffusione mondiale e si auto-regola in base ai feedback di milioni di utenti da cui apprende in tempo reale, dei regolamenti eccessivi potrebbero sia bloccare investimenti critici perché la situazione legislativa è poco chiara, sia ritardare l’evoluzione di una tecnologia a causa di leggi troppo frenanti per un mercato che si regola da sé dato che i feedback degli utenti forzano le aziende a porre determinati paletti.