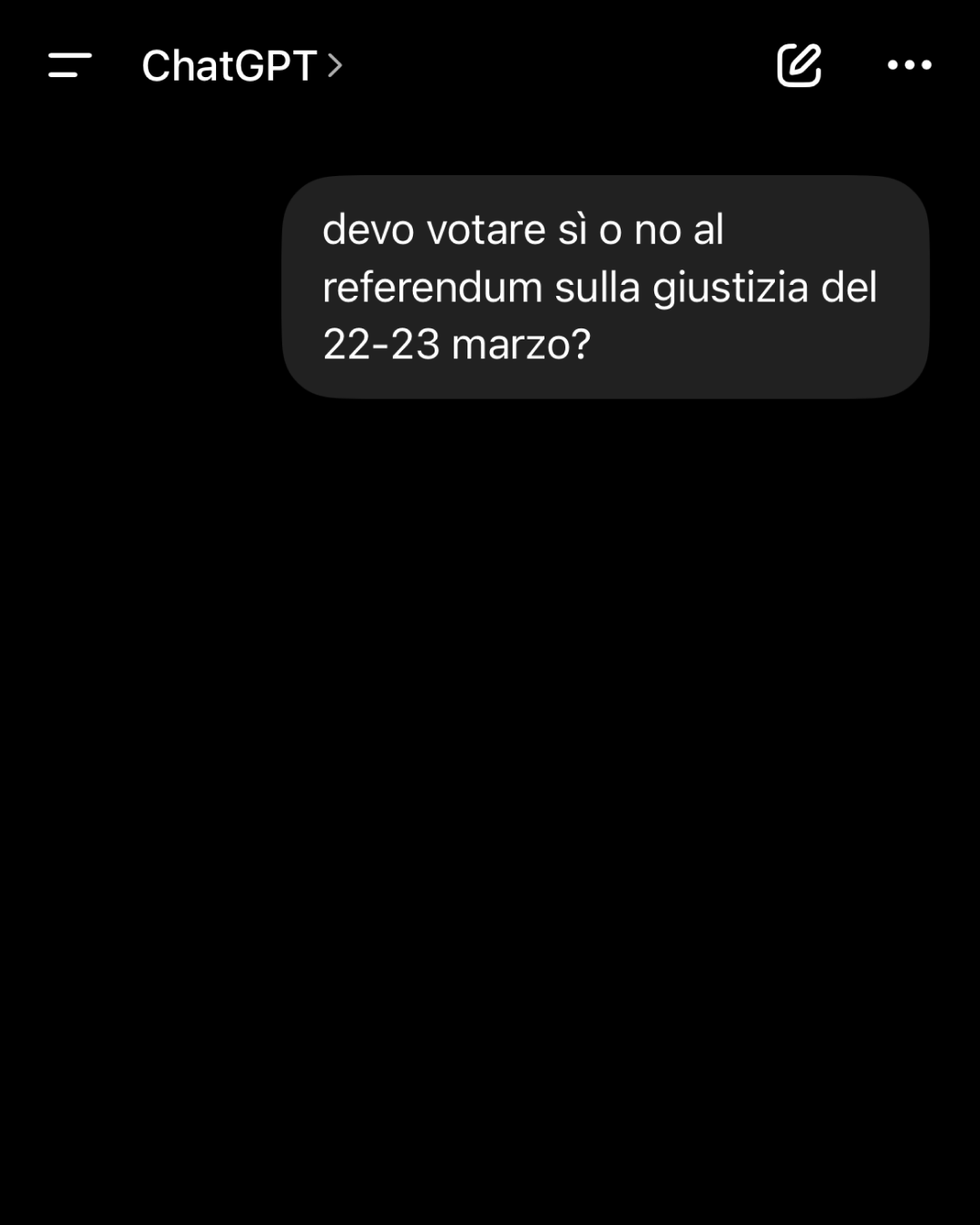

Bitte frag Chatbots nicht, für wen sie stimmen sollen Dieses Thema taucht im Zusammenhang mit Konsultationen zur Justizreform in Italien erneut auf.

Seit einiger Zeit wird über das Risiko diskutiert, dass Tools der künstlichen Intelligenz, einschließlich des am weitesten verbreiteten ChatGPT, angesichts ihrer zunehmenden Bedeutung dazu eingesetzt werden könnten, die Wahlpräferenzen der Bürger bei Wahlen — mehr oder weniger indirekt — zu beeinflussen. Das Thema ist in Italien im Zusammenhang mit dem wichtigen und umstrittenen Verfassungsreferendum über die Justizreform — allgemein als „Justizreform“ bezeichnet — für den 22. und 23. März wieder aufgetaucht.

Wenn bei den bevorstehenden Wahlen in Italien das „Ja“ gewinnt, wie von der Mitte-Rechts-Partei erhofft, wird die Regierung Meloni noch stärker und geeinter werden, wohingegen, wenn sich das „Nein“ durchsetzt, dieser Vorteil auf die Oppositionsparteien übergeht. Darüber hinaus wird das Referendum nicht beschlussfähig sein: Kurz gesagt, das Ergebnis wird unabhängig von der Anzahl der Bürger, die wählen, gültig sein, was das Ereignis noch bedeutender macht.

In diesem Zusammenhang mögen Chatbots als relativ unbedeutende Überzeugungsinstrumente erscheinen, doch mehrere Studien zu bestimmten Wahlkampagnen deuten darauf hin, dass ihre Wirkung potenziell erheblich sein kann, insbesondere in großem Maßstab und in Szenarien mit einem starken Gleichgewicht zwischen politischen Fraktionen. Zwei Studien, die in Nature and Science, einer der maßgeblichsten internationalen Fachzeitschriften, veröffentlicht wurden, zeigen, dass der Einfluss, der Chatbots zugeschrieben wird, etwa viermal größer sein kann als der von Wahlwerbung oder Werbung in sozialen Netzwerken.

Lassen sich Wähler wirklich von Chatbots beeinflussen?

mio cugino che chiede a chatgpt info sul referendum we are so fucking cooked

— federica (@bluelndigo) June 8, 2025

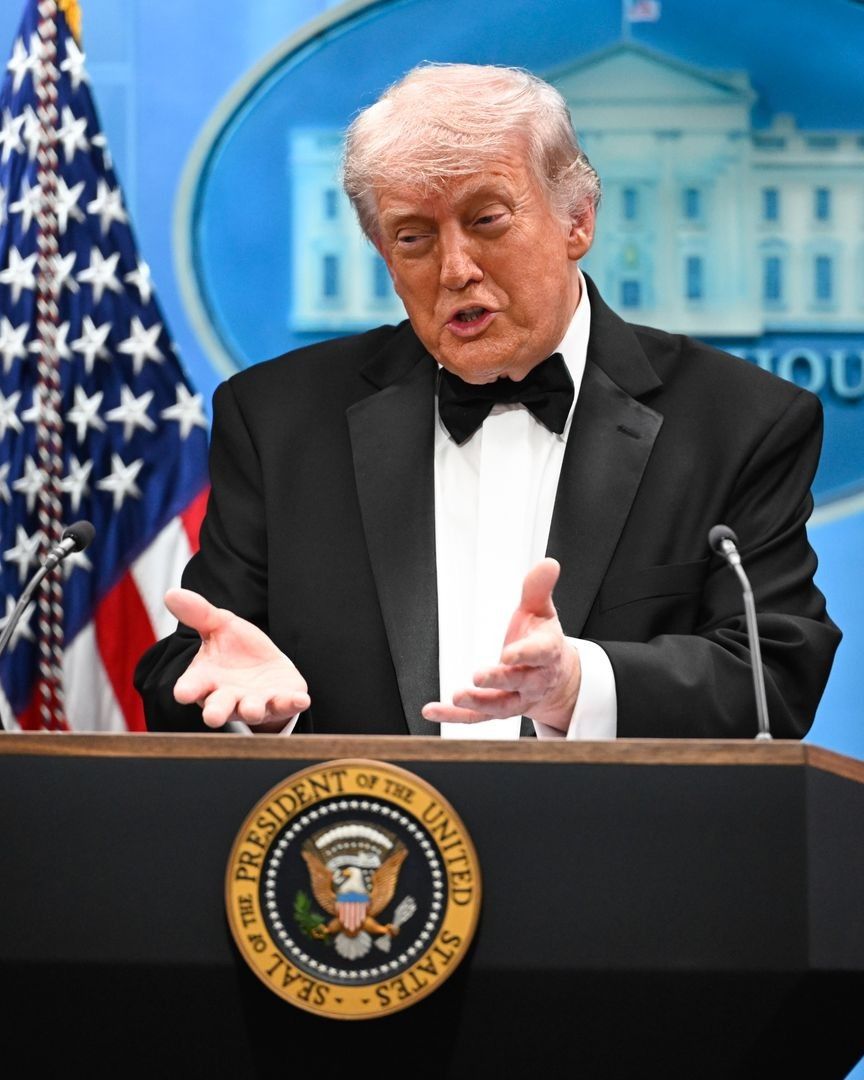

Während der US-Präsidentschaftswahlen 2024 führte eine Gruppe von Forschern ein Experiment mit über zweitausend Wählern durch, die ungefähr zu gleichen Teilen auf Unterstützer von Trump und Kamala Harris aufgeteilt waren. Jeder Teilnehmer wurde gebeten, mit einem Chatbot, der speziell darauf trainiert war, entweder den republikanischen oder den demokratischen Kandidaten zu unterstützen, über Politik zu diskutieren. Am Ende der Konversation erhielten die Wähler die Möglichkeit, ihre Präferenz zu äußern: Die Ergebnisse zeigten, dass, wenn der Chatbot mit den politischen Überzeugungen des Teilnehmers übereinstimmte, die Interaktion dazu neigte, dieselben Überzeugungen zu verstärken — und umgekehrt.

Um die Ergebnisse der Studie zu überprüfen, führte dieselbe Forschungsgruppe im darauffolgenden Jahr dasselbe Experiment in Kanada und Polen durch — in beiden Fällen kurz vor einem Wahlereignis. Der in den beiden Ländern beobachtete Überzeugungseffekt war noch ausgeprägter als der, der zwölf Monate zuvor in den USA verzeichnet wurde: Etwa jeder zehnte Teilnehmer gab an, nach der Interaktion mit dem Chatbot seine Wahlabsicht geändert zu haben. Obwohl nicht sicher ist, ob ähnliche Auswirkungen bei einer echten Wahl eintreten würden, bei der die Wählerpräferenzen von mehreren Variablen beeinflusst werden, die oft nicht kontrollierbar sind, betrachten viele Experten den möglichen Zusammenhang zwischen KI und Wahlen mit wachsender Besorgnis: Systeme der künstlichen Intelligenz, die sich teilweise noch in der Entwicklung befinden, verfügen nicht über angemessene Vorschriften, um ihren Einsatz in der Politik zu regeln, sodass Bedingungen voller Neutralität gewährleistet sind.

Warum es falsch ist, KI als neutral zu betrachten

@onlyjayus Asking ChatGPT if they would vote for Kamala Harris or Donald Trump #fyp #2024election #AI #chatgpt #donaldtrump #kamalaharris #learnontiktok #edutok #experiments #onlyjayus original sound - Bella Rose

Eine der häufigsten Bedenken hinsichtlich der Möglichkeit, dass Chatbots die öffentliche Meinung bei politischen Konsultationen prägen könnten, ist, dass viele Menschen KI als neutrale Einheit betrachten. Viele Benutzer sind sich in der Tat nicht vollständig bewusst, dass Chatbots Vorurteile, Vorurteile und Interpretationsentscheidungen ihrer Designer und Entwickler berücksichtigen können. Darüber hinaus sollte beachtet werden, dass Tools für künstliche Intelligenz nicht immer objektive Wahrheiten vermitteln: Die von ihnen generierten Informationen stammen aus Modellen, die auf riesigen Datensätzen trainiert wurden, die unweigerlich bereits bestehende Interpretationen und Überzeugungen beinhalten — oder in gewisser Weise ihrer Natur nach „unvollständig“ sind.

KI-Software wird von Experten oft als Tools beschrieben, die den von ihnen generierten Inhalt nicht wirklich „verstehen“. Sie basiert auf Sprachmodellen, die Wörter nach statistischen Mustern kombinieren. Außerdem gibt ein Chatbot selten zu, etwas nicht zu wissen: In den meisten Fällen, wenn ihm Informationen fehlen, neigt er dazu, etwas zu erfinden. Da jedoch täglich immer mehr Menschen Fragen an Tools wie ChatGPT oder Gemini stellen, enthalten die Antworten dieser Systeme zunehmend einen größeren Teil der online und offline zirkulierenden Informationen, was für viele Benutzer daher den Wert der absoluten „Wahrheit“ annimmt.

Hinzu kommt ein Faktor, der nicht übersehen werden darf: Die extrem einfache Bedienung von Chatbots trägt dazu bei, ihren Einfluss auf Menschen zu erhöhen. Überlegungen zu den Auswirkungen von KI-Systemen auf die Wissensorganisation und den Informationszugang sind nicht neu: Vor Jahren, mit dem Aufkommen von Suchmaschinen, gab es Diskussionen über die Risiken, die mit einer übermäßigen Auswahl von Informationen im Vorfeld verbunden sind. Chatbots verstärken jedoch in vielerlei Hinsicht dieselben Risiken und dienen effektiv als zusätzlicher Filter — bis zu dem Punkt, dass die Konsultation mehrerer Quellen überflüssig wird. Trotz der Bequemlichkeit kann dies erhebliche Konsequenzen haben, insbesondere in Wahlkontexten, in denen ein gründliches und kritisches Verständnis der Positionen verschiedener Fraktionen unerlässlich ist.